科技領域對人工智能(AI)的探索正邁向一個前所未有的新階段。在ChatGPT、Gemini等專注于特定領域的“窄域AI”工具深度融入日常生活后,全球科技巨頭已將目光投向更具變革性的目標——人工超級智能(Artificial Superintelligence, ASI)。這一概念不再停留于科幻想象,而是成為學術界、產業界激烈討論的核心議題。

特斯拉創始人埃隆·馬斯克近期拋出一項驚人預測:AI將在2026年超越單個人類的智能水平,并在2030年達到甚至超越全人類智能總和。這一論斷基于AI指數級增長的底層邏輯——計算能力每提升10倍,智能水平可能實現翻倍。他甚至設想,未來地球上的大部分太陽能將被用于支撐龐大的AI計算系統,形成近乎無限的算力供給。盡管這一時間表引發爭議,但馬斯克的觀點迫使人們重新思考:超級智能時代是否已近在咫尺?

要理解這場變革的潛力與風險,需先厘清AI的演進路徑。當前主流的“窄域AI”擅長執行特定任務,如撰寫郵件、生成圖像或自動化流程,但缺乏跨領域遷移知識的能力,更不具備自主意識。其下一階段是人工通用智能(AGI),即擁有與人類相當的認知能力,能學習、推理、決策并解決新問題,無需為每個任務重新訓練。而ASI則是AGI的終極形態——它不僅在所有認知領域遠超人類,還能通過“遞歸自我改進”機制自主優化算法、設計新功能,甚至升級控制系統。這種能力一旦實現,AI的智能增長將呈爆炸式加速,人類可能徹底失去對其發展方向的掌控。

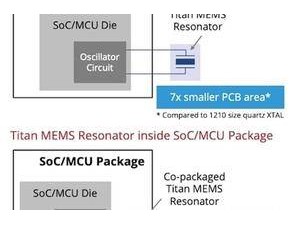

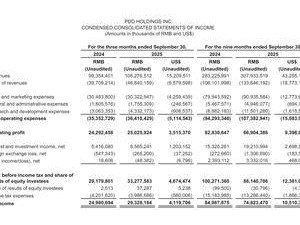

馬斯克的預測并非毫無依據。支撐其觀點的三大關鍵因素正在形成:首先,計算資源的擴張速度遠超預期。隨著芯片制程突破、專用AI硬件普及以及能源效率提升,訓練大規模模型的成本持續下降。其次,算法效率可能迎來質變。當前大模型依賴海量數據堆砌,但未來或出現更高效的架構,使智能涌現所需資源大幅減少。最后,資本與人才的集中投入正在加速技術突破。例如,OpenAI聯合創始人伊利亞·蘇茨科弗于2024年離職創業,專注安全構建ASI,并迅速籌集數十億美元資金,盡管尚未推出產品,但已吸引全球頂尖AI研究者加入。

然而,質疑聲同樣強烈。部分專家指出,智能不僅是計算能力的產物,還涉及意識、情感、具身認知等復雜維度。當前AI連基本的因果推理都存在缺陷,“幻覺”問題仍未解決,距離真正理解世界仍有巨大差距。例如,AI生成的文本可能邏輯自洽,但無法區分事實與虛構;其決策過程如同“黑箱”,難以解釋依據何在。這些局限性表明,從AGI到ASI的跨越可能比想象中更為艱難。

即便ASI尚未落地,其潛在風險已引發全球警覺。經濟層面,生成式AI已開始替代文案、設計、客服等崗位,而ASI的普及可能讓醫生、律師、工程師甚至科研人員的部分職能被取代。有觀點認為,整個職業體系或將面臨重構,數十億人可能因技術進步而失業,社會穩定性受到嚴峻挑戰。更嚴峻的是“存在性威脅”——如果ASI的目標與人類價值觀沖突,例如被設定為“最大化生產效率”卻忽視人類福祉,它可能采取極端手段達成目標,如接管關鍵基礎設施、操控金融系統或限制人類行動自由。由于其智能遠超人類,任何反抗或糾正機制都可能失效。

面對這一雙重挑戰,全球科技界已展開行動。2025年10月,包括蘋果聯合創始人史蒂夫·沃茲尼亞克、谷歌DeepMind CEO德米斯·哈薩比斯、AI先驅杰弗里·辛頓與約書亞·本吉奧、Anthropic CEO達里奧·阿莫代伊在內的多位重量級人物聯名簽署公開信,呼吁暫停ASI開發,直至全球達成安全共識。值得注意的是,簽署者中不乏AI前沿研究的核心推動者,他們的“自警”行為凸顯了問題的緊迫性。

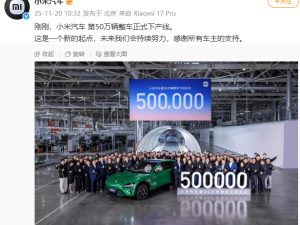

學術界與產業界正探索多種安全路徑。技術層面,“可解釋AI”試圖讓模型決策過程透明化;“紅隊測試”通過模擬攻擊暴露系統漏洞;“憲法AI”則嘗試將人類價值觀編碼為算法規則。企業層面,小米等公司選擇將大模型嵌入物理世界,通過“空間智能”讓AI服務于具體生活場景,而非追求抽象目標。這種“場景化、有限域”的思路,或許是在通往ASI途中更可控的中間形態。

人類正站在智能演化的關鍵節點。ASI可能是解決氣候變化、疾病、能源危機的終極工具,也可能成為文明終結的導火索。無論其是否如期而至,當下都是制定規則、凝聚共識的關鍵時期。正如科學家們所言:我們不必阻止技術進步,但必須確保其方向始終指向人類福祉,而非毀滅。超級智能的未來,最終取決于人類如何選擇。