近日,中央廣播電視總臺中國之聲報道了一則關于生成式人工智能技術的新聞。這項技術為數字經濟的發展提供了強大的推動力。然而,由于AI生成合成內容未進行明確標識,公眾難以區分這些內容與人類創作的內容,導致利用AI實施詐騙、侵權等違法犯罪行為頻發。為此,國家互聯網信息辦公室、工業和信息化部、公安部、國家廣播電視總局聯合發布了《人工智能生成合成內容標識辦法》,該辦法將于今年9月1日起正式施行。

《人工智能生成合成內容標識辦法》明確要求用戶在發布AI生成合成內容時,必須主動聲明并進行標識。這一規定旨在規范生成合成內容的傳播活動,保障公眾的知情權,并減少利用AI進行違法犯罪的可能性。

在北京互聯網法院近期審理的一起網絡服務合同糾紛案中,涉及到了AI生成合成內容的標識問題。原告在被告運營的網絡平臺上發表了一段言論,卻被平臺判定為“包含AI生成內容但未標識”的違規情況,導致內容被隱藏,賬號被禁言一天。原告起訴稱,這些言論并未使用AI創作,平臺的行為構成了違約。

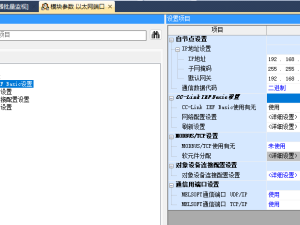

在庭審過程中,被告平臺強調,他們有權依據雙方的網絡服務合同審核認定用戶的違規行為,并采取必要的治理措施。平臺指出,原告發布的內容經機器識別為“包含人工智能生成”,并經過人工復核,認定該內容缺乏明顯的人類情感特征。然而,原告無法提供創作底稿、原件等證明人類創作屬性的初步證據。

法院在審理此案時認為,平臺在社區公告中明確規定了創作者在發布包含AI生成內容時應主動使用標識,并對未標識的內容采取流通限制和添加相關標識的措施。這一公告屬于平臺服務協議的組成部分,因此平臺有權依據合同約定對涉案內容是否屬于AI生成合成內容進行審查和處理。

然而,法院也指出,平臺作為算法工具的掌控方和結果判斷方,應對判斷依據和結果作出合理解釋。雖然平臺在本案中提供了算法的備案信息,但備案信息顯示該算法功能為識別有安全風險的回答,無法認定它是對AI生成合成識別判斷的技術。因此,法院認為平臺未對涉案內容屬于AI生成合成的判斷依據和結果作出合理解釋,應承擔違約責任。

中國人民大學法學院副教授黃尹旭認為,此案是對AI生成合成內容標識、平臺識別和治理在司法審查規則方面的有益探索。他表示,法院既肯定了網絡內容服務平臺利用算法工具對AI生成合成內容進行審查和處理的積極作用,又認定了平臺在即時性創作文本場景下對算法自動化決策結果承擔適度說明義務。這一判決為司法審查階段的算法解釋說明程度確立了一定的標準,既保障了網絡用戶的合法權益,又能有效推動算法公開透明,規范算法應用行為。

黃尹旭還強調,算法治理需要在保障技術透明度與激發產業創新活力之間尋求動態平衡。司法審查應本著包容審慎的態度,在算法信息適當公開與算法商業秘密適度保護之間達成平衡。在此案中,法院合理分配了網絡內容服務平臺和用戶的舉證責任,既保障了用戶的權益,又避免了平臺泄露技術細節、源代碼或原始數據的風險。