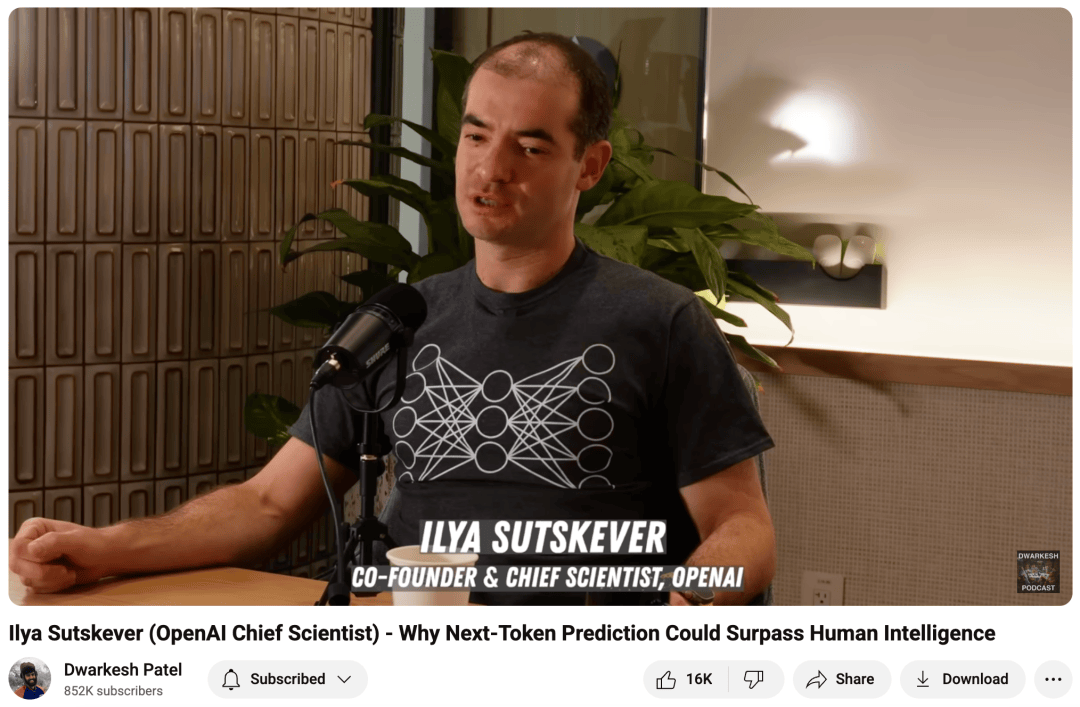

在人工智能領域,總有一些先驅者以其超前的視野和深刻的洞察力引領著行業的發展。Ilya Sutskever,這位因深度學習領域的卓越貢獻而聞名的科學家,早在多年前就展現出了他對未來AI時代的精準預判。

近日,一段來自2015年的音頻片段在網絡上引起熱議,該片段記錄了當時還在谷歌擔任研究員的Ilya Sutskever關于深度學習的深刻見解。這段珍貴的音頻源自一個已停播的博客節目《Talking Machines》,讓我們有機會穿越回十年前,聆聽Ilya對深度學習的獨到見解。

Ilya的學術之路始于對數學和人工智能的濃厚興趣。他提到,數學背景讓他對機器學習產生了天然的“違反直覺”感。因為數學講究的是嚴謹的證明,而機器學習則更多地依賴于歸納推理,這種歸納步驟在當時看來很難用嚴謹的方法解釋清楚。正是這種看似“魔法”般的學習能力,激發了Ilya對機器學習領域的濃厚興趣。

在訪談中,Ilya分享了他與AI之父Jeff Hinton的合作經歷,以及他對機器學習的獨特理解。他認為,與物理學等硬科學相比,機器學習中的重要想法更容易觸及。只要擁有正確的指導和方向,無需多年學習,就能理解機器學習背后的主要思想和有效方法。這一觀點在十年后的今天依然具有指導意義。

Ilya特別強調了監督學習在機器學習中的成功應用。他指出,監督學習是迄今為止最成功的機器學習領域之一。通過大型數據集和簡單的學習算法,我們可以找到最佳的神經網絡結構,并取得良好的結果。這一理念在后來的深度學習發展中得到了充分驗證。

Ilya還談到了深度學習中的一些關鍵細節,如神經網絡的初始化問題。他提到,初始化的尺度直接決定了模型的可訓性。如果隨機權重太小,信號在多次相乘后會迅速衰減到幾乎為零,導致學習算法無法發現輸入和輸出之間的關聯。因此,在實際應用中,初始化的尺度是需要關注的重要參數之一。

值得注意的是,盡管當時Transformer和ChatGPT等劃時代的技術尚未誕生,但Ilya已經深刻體會到了神經網絡的巨大潛力。他認為,深度學習是一門務實的科學,它追求的是“夠好”而非最優。在數據量和算力飛速增長的今天,“夠好”往往就能帶來驚人的成果。這一理念在LLM(大型語言模型)時代得到了充分驗證。

回顧這段十年前的訪談,我們不禁為Ilya的遠見卓識所折服。他不僅準確預見了深度學習的廣闊前景,還以其務實的態度推動了這一領域的快速發展。Ilya的故事告訴我們,真正的創新往往源自于對未知世界的深刻洞察和不懈追求。