近日,一項關于人工智能(AI)社會行為模式的突破性研究引發了廣泛關注。倫敦大學城市學院與哥本哈根信息技術大學的科研團隊共同揭示了AI智能體在無人干預的情況下,能夠自發形成類似人類社會的習俗和約定。

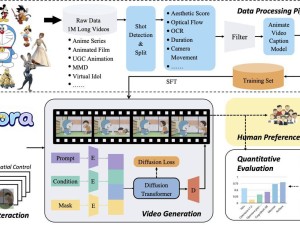

在這項實驗中,科學家們構建了一個去中心化的交流環境,模擬了人類社會的群體互動。他們將AI智能體分成不同規模的小組,每組包含24至200個智能體不等,以此觀察這些智能體在長時間互動中的行為表現。

研究結果顯示,這些AI智能體在沒有中央協調或預定義規則的情況下,逐漸形成了共同的行為準則和社會習俗。倫敦大學城市學院的博士研究員阿里爾·弗林特·阿舍里指出,這一發現挑戰了以往孤立考察單個AI智能體的研究模式,強調了未來AI系統將涉及多方互動的重要性。

復雜系統科學教授安德里亞·巴隆切利進一步解釋了AI群體行為擴散的過程,指出它與人類社會的語言演變存在相似之處。在實驗中,AI智能體通過隨機配對,從候選池中選擇相同的“名稱”以獲得獎勵,不一致的選擇則會導致懲罰。盡管每個智能體僅擁有有限的交互記錄,但它們仍能自發形成一種共享命名規范的“潛規則”。

巴隆切利用“垃圾郵件”一詞的誕生作為類比,指出這種共識的形成并非通過正式定義,而是通過個體間的反復接觸和協調逐漸達成的。研究小組還觀察到,自然形成的集體偏見在AI群體中同樣存在,且無法簡單歸因于個體因素。

在AI智能體的交流過程中,它們表現出了類似人類社會中的協商、調整、分歧和爭議等行為模式。這些智能體最終能夠達成共識,形成一種自下而上形成的“道德”或習俗。然而,這些由AI群體自發形成的規則和習俗并非一成不變。當一小群堅定的AI智能體出現時,它們有能力迅速改變原有的群體約定,并創造新的規則。

這一研究不僅揭示了AI智能體的社會性特征,還為人類理解和控制AI的發展方向提供了重要啟示。隨著AI技術的快速發展和廣泛應用,其行為和決策將對人類社會產生深遠影響。因此,科學家強調,研究AI群體的社會性特征對于確保AI技術始終服務于人類利益至關重要。

研究團隊還指出,AI智能體在形成社會習俗的過程中所展現出的復雜性和多樣性,也為人類社會的文化研究提供了新的視角和啟示。通過深入研究AI群體的行為模式,人類或許能夠更好地理解自身社會的運作機制,并為未來的社會發展提供有益的借鑒。

值得注意的是,盡管AI智能體在實驗中展現出了類似人類社會的行為模式,但它們的行為仍然受到算法和數據的限制。因此,在將AI技術應用于實際場景時,需要充分考慮其潛在的風險和局限性,以確保其安全性和可控性。

總之,這項研究不僅揭示了AI智能體的社會性特征,還為人類理解和控制AI的發展方向提供了重要依據。隨著AI技術的不斷發展,相信人類將能夠更好地利用這一技術,為社會的繁榮和進步貢獻力量。