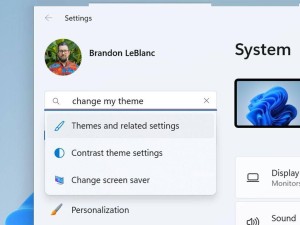

騰訊云AI代碼助手近日迎來(lái)重大升級(jí),正式引入了DeepSeek-V3-0324這一頂級(jí)模型。這一升級(jí)無(wú)需繁瑣配置,用戶只需下載或更新AI代碼助手插件即可享受。

據(jù)官方宣稱,這一升級(jí)將帶來(lái)前所未有的開(kāi)發(fā)效率提升,甚至可能達(dá)到100倍的驚人增幅。

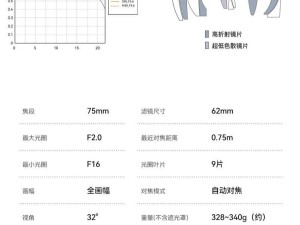

DeepSeek-V3-0324作為DeepSeek-V3系列的一次小版本迭代,其模型參數(shù)從初代的6710億小幅增加至6850億。該模型繼續(xù)沿用混合專家(MoE)架構(gòu),每個(gè)token激活約370億參數(shù),在推理、編程、數(shù)學(xué)以及中文處理等多個(gè)領(lǐng)域均展現(xiàn)出了行業(yè)領(lǐng)先的實(shí)力。

DeepSeek-V3-0324在解決一些復(fù)雜問(wèn)題上表現(xiàn)出了卓越的能力。例如,在近期備受關(guān)注的“7米甘蔗過(guò)2米門”AI測(cè)試題中,它能夠自主發(fā)現(xiàn)隱藏解法,并給出合理的答案。

騰訊總結(jié)了DeepSeek-V3-0324的五大顯著優(yōu)勢(shì)。首先,該模型采用了創(chuàng)新的訓(xùn)練策略,包括無(wú)輔助損失的負(fù)載均衡、多token預(yù)測(cè)訓(xùn)練以及FP8混合精度訓(xùn)練等,這些策略有效避免了傳統(tǒng)方法的性能損失,顯著降低了計(jì)算成本,并提高了訓(xùn)練效率。

其次,DeepSeek-V3-0324對(duì)MoE架構(gòu)進(jìn)行了優(yōu)化。通過(guò)動(dòng)態(tài)調(diào)整偏差項(xiàng)、節(jié)點(diǎn)受限路由機(jī)制以及FP8調(diào)度與RDMA優(yōu)化等技術(shù)手段,該模型在防止路由崩潰的同時(shí),性能提升了15%以上,訓(xùn)練效率更是提升了40%。它還支持128K超長(zhǎng)上下文,能夠處理50頁(yè)P(yáng)DF或完整代碼庫(kù),多輪對(duì)話記憶能力顯著增強(qiáng)。

在綜合能力方面,DeepSeek-V3-0324相較于初代V3在關(guān)鍵指標(biāo)上取得了突破性進(jìn)步。例如,在MMLU-Pro、GPQA、AIME以及LiveCodeBench等多項(xiàng)權(quán)威基準(zhǔn)測(cè)試中,該模型的表現(xiàn)均有了顯著提升。特別是在數(shù)學(xué)競(jìng)賽解題能力方面,AIME競(jìng)賽正確率提升了近20%,超越了Grok3。同時(shí),該模型在中文處理方面也展現(xiàn)出了明顯優(yōu)勢(shì),中長(zhǎng)篇寫作邏輯更嚴(yán)密,聯(lián)網(wǎng)搜索報(bào)告更精準(zhǔn)。

在編程生成能力方面,DeepSeek-V3-0324同樣表現(xiàn)出色。它能夠精準(zhǔn)生成800行無(wú)錯(cuò)誤的網(wǎng)頁(yè)代碼(含動(dòng)態(tài)交互,視覺(jué)美觀),代碼可運(yùn)行率高達(dá)92%。該模型還支持20多種編程語(yǔ)言,前端開(kāi)發(fā)效率提升了80%。在kcores-llm-arena評(píng)測(cè)中,它的表現(xiàn)也超越了Claude 3 Sonnet普通版。

最后,DeepSeek-V3-0324在推理與開(kāi)發(fā)者體驗(yàn)方面也進(jìn)行了諸多優(yōu)化。借鑒DeepSeek R1模型訓(xùn)練技術(shù),該模型的推理任務(wù)顯著提升,上線每秒可生成20多個(gè)token(在M3 Ultra設(shè)備上),響應(yīng)速度比前代快40%。同時(shí),智能補(bǔ)全、代碼糾錯(cuò)、API兼容性檢測(cè)等功能也得到了大幅提升,進(jìn)一步提高了開(kāi)發(fā)效率。